Internet se rebela contra a ditadura dos algoritmos

Facebook e Google corrigem seus sistemas de inteligência artificial para mostrar a seus usuários uma visão de mundo mais real

Pressionado pela crise das notícias falsas, o Google reagiu com mudanças em sua joia da coroa, os algoritmos de busca: a partir desta semana darão mais peso às páginas consideradas mais confiáveis e tornarão menos visíveis os conteúdos de baixa credibilidade. Depois de meses de testes, as melhorias anunciadas pretendem evitar que os primeiros lugares das buscas continuem exibindo páginas que negam o Holocausto, divulgam mensagens vergonhosas contra as mulheres ou difundem boatos como o de que Barack Obama prepara um golpe de Estado contra Donald Trump.

Com o mesmo objetivo, o Facebook começa a permitir aos usuários que denunciem informações duvidosas. A partir desta semana, também passa a mostrar abaixo delas notícias confiáveis sobre o mesmo tema e também links para sites de checagem de dados.

A divulgação de mentiras, informações muito tendenciosas, rumores e boatos foi protagonista nas campanhas do Brexit e das eleições presidenciais nos EUA e colocou sob escrutínio os algoritmos de Google e Facebook, acusados de favorecer a divulgação de notícias falsas e a criação de bolhas ideológicas. Isso porque as redes sociais mostram na timeline de cada usuário o que seus algoritmos intuem que a pessoa vai gostar, favorecendo notícias que confirmam sua visão de mundo diante das que questionam suas ideias, segundo adverte o relatório do projeto REIsearch, patrocinado pelo Atomium (o Instituto Europeu para a Ciência, Meios de Comunicação e Democracia), que acaba de lançar uma grande pesquisa pública para questionar os europeus sobre este e outros impactos da nova geração de tecnologias da Internet.

“Culpar as redes sociais pelas bolhas ideológicas é um paradoxo. Ampliam a visão dos usuários para além de seu entorno mais próximo, mas não resolveram um problema que já existia, porque seus algoritmos ainda não são suficientemente bons”, afirma David García, pesquisador da área de ciências sociais computacionais na Escola Politécnica Federal de Zurique. Ali ele analisa se o conteúdo emocional das notícias falsas contribuiu para aumentar sua difusão. E destaca que os algoritmos podem detectá-las melhor se forem alimentados com dados sobre como são compartilhadas as notícias nas redes sociais.

Monitorar os usuários

“A pesquisa sobre as redes sociais permite identificar os usuários que compartilham notícias não verazes. Um algoritmo poderia detectar que uma notícia está sendo compartilhada por muitos desses usuários e classificá-la como possivelmente falsa”, afirma David García. “Imagino que o Google esteja fazendo algo parecido para melhorar seu algoritmo, mas o problema é que não sabemos o que é.”

Em 2015, um grupo de cientistas do Google publicou um artigo de pesquisa no qual explicava um novo método para avaliar a qualidade dos sites em função da veracidade dos dados que contém, em vez do método tradicional do buscador, que determina a popularidade de um site combinando uma multiplicidade de sinais externos, como o número de links para ele a partir de outros sites. O Google não esclarece se incorporou esse algoritmo da verdade em suas melhorias recentes.

Walter Quattrociocchi, pesquisador da área de ciência de dados, redes e algoritmos no IMT – Institute for Advanced Studies italiano, alerta sobre essa ideia: “Um algoritmo, por definição, nunca será capaz de distinguir o verdadeiro do falso”. Carlos Castillo, que dirige o grupo de pesquisas de ciência de dados no Eurecat (Barcelona), concorda: “Decidir se algo é verdadeiro ou falso não é algo que devemos terceirizar para uma máquina. Nem para outras pessoas. Não pode haver um Ministério da Verdade [como o do romance 1984, de George Orwell], tampouco um algoritmo da verdade”.

Pelo contrário, o pesquisador afirma que a maioria das mudanças anunciadas por Google e Facebook nas últimas semanas aplicam soluções baseadas na participação humana. Castillo defende o fomento do ceticismo visível: destacar as notícias falsas e contextualizá-las, ao contrário das exigências de que Facebook e Google as eliminem.

Soluções humanas: educação e verificação de dados

“O que sim podemos pedir a um algoritmo é que nos ajude a avaliar a veracidade de uma informação, destacando os dados e demais elementos que devemos comparar para formar nossa opinião”, acrescenta o pesquisador Carlos Castillo.

"Decidir se algo é verdadeiro ou falso não é algo que devemos terceirizar para uma máquina. Nem sequer para outras pessoas."

Assim, a Full Fact, uma agência independente de verificação de dados, prevê que este ano seus revisores possam começar a usar inteligência artificial para agilizar seu trabalho. Google e Facebook começaram a dar visibilidade a estas verificações humanas ao lado das notícias que divulgam, para que os usuários possam avaliar melhor sua veracidade.

Walter Quattrociocchi destaca a necessidade de “sinergias entre jornalistas e instituições acadêmicas para promover um intercâmbio cultural e combater a difusão de notícias falsas”. “O problema não será resolvido pelos algoritmos”, adverte David García. E Carlos Castillo concorda também que “nos falta alfabetização midiática: ainda não desenvolvemos certas habilidades para avaliar as notícias, mas faremos isso”. Na mesma linha, Andreas Schleicher, diretor de Educação da OCDE (Organização para a Cooperação e o Desenvolvimento Econômico) anunciou que a análise crítica de informações digitais será incorporada ao próximo relatório PISA, que em 2018 avaliará o rendimento acadêmico dos estudantes de nível secundário internacionalmente.

MEDIDAS CONTRA AS NOTÍCIAS FALSAS

Esta semana o Google implementou mundialmente uma série de medidas que vinha experimentando nos últimos meses:

- Atualização dos algoritmos de busca, para dar mais credibilidade às páginas e penalizar as que divulgam conteúdos menos confiáveis.

- Melhora da avaliação das buscas, nas experiências do Google para refinar seus algoritmos. As pessoas que analisam se os resultados são bons foram instruídas especificamente a detectar informações enganosas, resultados ofensivos, boatos e teorias da conspiração.

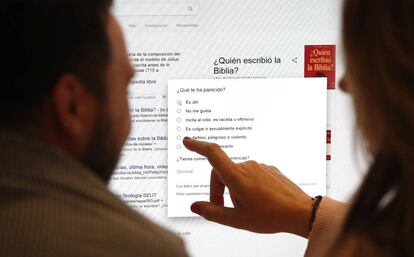

- Opinião dos usuários, que agora podem avaliar e denunciar conteúdos não adequados nas sugestões de busca e nos quadros destacados nos resultados. O Google usará este feedback para melhorar seus algoritmos, e poderá intervir manualmente em caso de erros grosseiros.

- Verificação de dados: uma nova tag destaca a veracidade dos artigos com informação checada pelos meios de comunicação e por organizações de fact-checking.

Ainda em fase de testes, e com diferente implantação em cada país, Facebook está reagindo também com estas medidas:

- Contexto e educação: a última novidade são as notícias relacionadas, que aparecem na timeline dos usuários em seguida de notícias que estão sendo muito comentadas, para fornecer outros pontos de vista. O Facebook também lançou um tutorial para detectar notícias falsas em 14 países.

- Bloqueios ao negócio dos produtores de notícias falsas, que investem em anúncios do Facebook e obtêm grandes benefícios com a infinidade de visitas que recebem em seus sites.

- Melhoras no ranking: as notícias consideradas suspeitas pelos algoritmos do Facebook terão menor protagonismo na timeline dos usuários.

- Denúncias dos usuários: as notícias marcadas como falsas por muitos usuários também perdem protagonismo.

- Verificação de dados: equipes externas de fact-checking destacam as notícias controversas. Os usuários verão uma marca e um link para a explicação dos verificadores; além disso, receberão um aviso se decidirem compartilhar essas notícias.

Tu suscripción se está usando en otro dispositivo

¿Quieres añadir otro usuario a tu suscripción?

Si continúas leyendo en este dispositivo, no se podrá leer en el otro.

FlechaTu suscripción se está usando en otro dispositivo y solo puedes acceder a EL PAÍS desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripción a la modalidad Premium, así podrás añadir otro usuario. Cada uno accederá con su propia cuenta de email, lo que os permitirá personalizar vuestra experiencia en EL PAÍS.

¿Tienes una suscripción de empresa? Accede aquí para contratar más cuentas.

En el caso de no saber quién está usando tu cuenta, te recomendamos cambiar tu contraseña aquí.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrará en tu dispositivo y en el de la otra persona que está usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquí los términos y condiciones de la suscripción digital.